Appearance

模型评估与优化

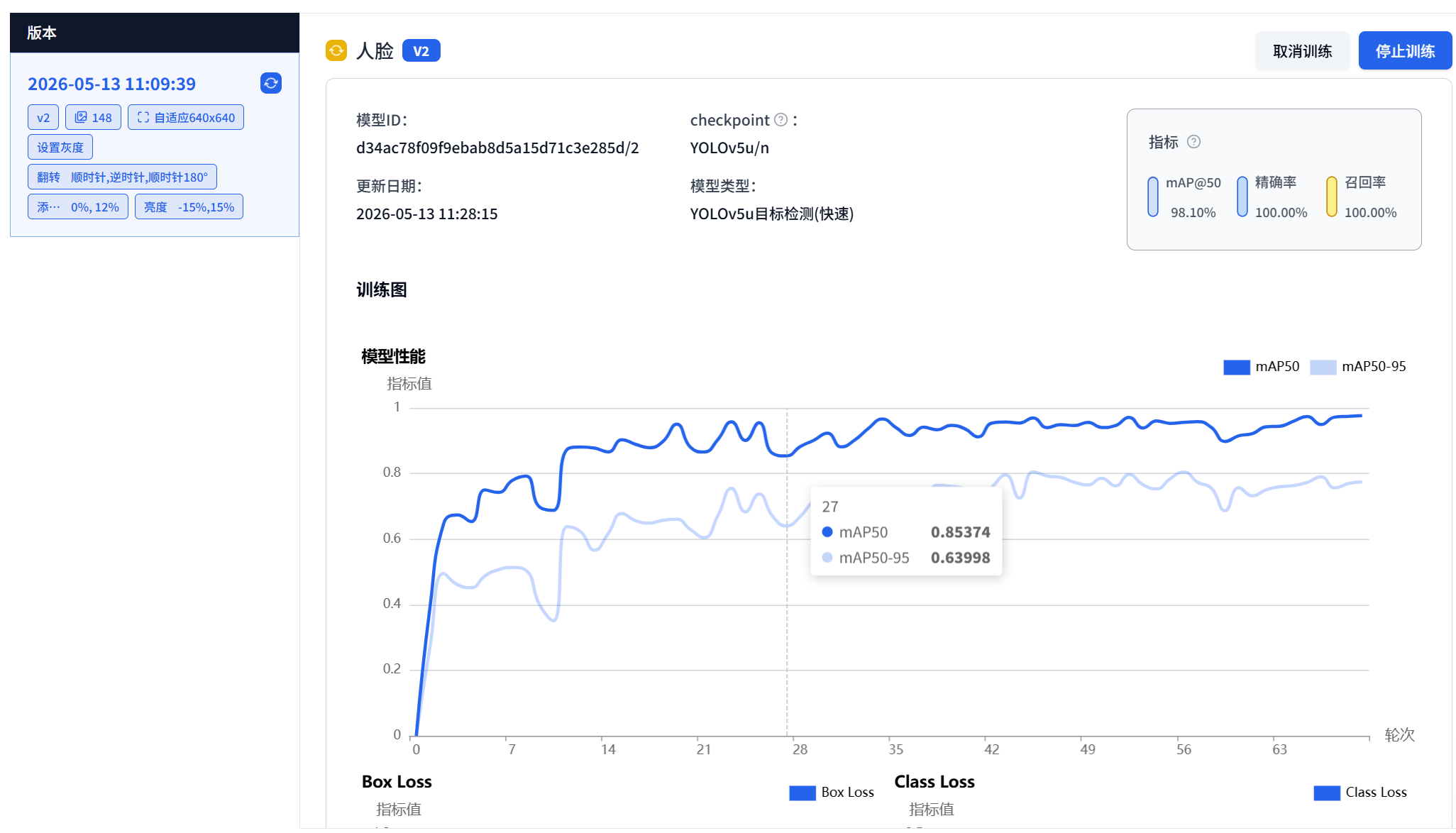

当前项目中的模型评估主要发生在模型列表页、模型详情页、版本列表页。

模型训练主要指标解析

模型相关页面已能展示以下指标:

- mAP(mAP@0.5):模型在 “框的定位不算特别严格” 的情况下,整体的检测性能,是最常用的对比指标,越高越好。

- mAP50-95:综合了 “粗定位” 到 “精定位” 的所有场景,更能反映模型的综合定位能力。比单纯的 mAP(mAP@0.5)严格得多!

- Box Loss:衡量模型预测的物体框(位置、大小)和真实标注框之间的误差,Box Loss 高 → 模型定位不准,框歪歪扭扭、大小不对;Box Loss 下降并趋于稳定 → 模型的定位能力在不断优化。

- Class Loss:衡量模型对框内物体类别的判断误差。Class Loss 高 → 模型分类不准,容易认错物体类别;Class Loss 下降并趋于稳定 → 模型的分类能力在不断优化。

- 精准率:模型预测出来的框里,有多少是 “真的物体”

- 召回率:真实存在的物体里,有多少被模型找出来了

TIP

怎么结合这些指标判断模型训练状态?

训练过程中,正常的趋势应该是:

✅ Box Loss、Class Loss 持续下降并趋于稳定(误差越来越小,不再大幅波动)

✅ mAP、精准率、召回率 持续上升并趋于稳定(检测性能越来越好,不再明显提升)

如果出现这些情况,就要警惕了:

1、Loss 一直下降,但 mAP 不升反降 → 模型过拟合了(在训练集上误差很小,但泛化到验证集上性能很差);

2、Box Loss 一直很高 → 模型定位能力弱,框不准,需要调整损失函数或数据增强;

3、Class Loss 一直很高 → 模型分类能力弱,认错率高,需要检查标注或类别不平衡问题;

4、mAP 高但召回率低 → 模型漏检多,很多真实物体没找到,可以适当降低置信度阈值;

5、mAP 高但精准率低 → 模型误报多,经常把背景当成物体,可以适当提高置信度阈值。

如何做版本对比

当前前端没有稳定的“多模型对比看板”说明,因此更可靠的做法是:

- 记录每个模型所属版本

- 对比各模型的 mAP、精准率、召回率

- 使用同一组图片做详情页预览比对